Saturs

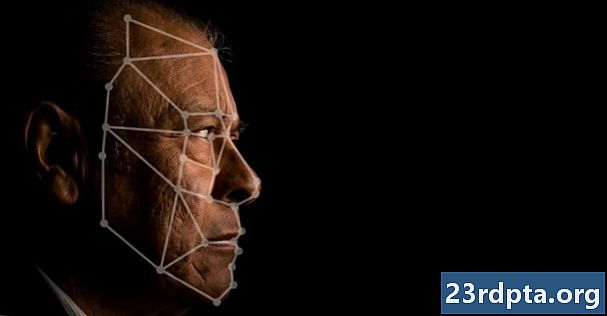

Deepfake saturs rada haosu to cilvēku vidū, kuri izauga ar domu, ka redzēt tic. Fotogrāfijas un video, kas kādreiz tika uzskatīti par nenoliedzamiem pierādījumiem par kaut ko notiekošu, tagad tiek apšaubīti masās. Tas ir sagaidāms pēc tam, kad būs noskaidrots pārsteidzoši reālistiskais Baraka Obamas video, kurā prezidents tiek saukts par Trumpu par “pilnīgu un pilnīgu iegremdēšanu ****”, bet tas ir nekas cits kā dziļa viltus radīšana.

Deepfake saturs rada haosu to cilvēku vidū, kuri izauga ar domu, ka redzēt tic.

Edgars ČervantessIesaistītā tehnoloģija palielina uzacis un rada jautājumus, tāpēc mēs esam šeit, lai sniegtu jums pilnīgu padziļinātu ieskatu par to, kas tas ir, kā tas darbojas un vai tiešām ir iemesls uztraukties.

Kas ir deepfake?

Deepfake ir AI (mākslīgā intelekta) paņēmiens, kas satura veidošanai vai manipulēšanai izmanto mašīnmācīšanos. To bieži izmanto, lai izveidotu montāžu vai pārklātu personas seju virs citas, taču tās iespējas sniedzas daudz tālāk. Šai tehnoloģijai ir daudz citu lietojumu. Tie ietver manipulācijas vai skaņas radīšanu, kustību, ainavas, dzīvniekus un citu.

Kā darbojas deepfake?

Deepfake saturs tiek izveidots, izmantojot mašīnmācīšanās paņēmienu, kas pazīstams kā GAN (ģeneratīvs sacīkstes tīkls). GAN izmanto divus neironu tīklus: ģeneratoru un diskriminatoru. Viņi pastāvīgi konkurē viens ar otru.

Ģenerators mēģinās izveidot reālistisku attēlu, savukārt diskriminētājs mēģinās noteikt, vai tas ir nepatiess. Ja ģenerators muļķo diskriminatoru, tas izmanto apkopoto informāciju, lai kļūtu par labāku tiesnesi. Tāpat, ja diskriminētājs nosaka, ka ģeneratora attēls ir viltus, ģeneratoram būs labāk, lai izveidotu viltus attēlu. Nebeidzams cikls var turpināties, kamēr attēls, video vai audio vairs nav tik viltoti cilvēka skatījumā.

Izcelsme

Pirmie dziļi fake video acīmredzami bija porno!

Edgars Červantess

Pirmie dziļi fake video acīmredzami bija porno! Konkrētāk, bija ierasts redzēt slavenību sejas virspusē kā porno aktrises. Starp citiem jautrajiem izgudrojumiem bija populāras arī Nikolaja Keidža meimas.

Vārds deepfake kļuva par šīs tehnikas sinonīmu 2017. gadā, pateicoties Reddit lietotājam, kurš devās ar vārdu “deepfakes”. Lietotājam pievienojās citi lietotāji, kuri tagad ir aizliegti r / dziļi fake subreddit, kur viņi dalījās ar savu darbu ar pasauli.

Patiesais ģeneratīvo sacīkstes tīklu radītājs ir Īans Labfoless. Kopā ar saviem kolēģiem viņš 2014. gadā iepazīstināja ar šo koncepciju Monreālas Universitātē. Pēc tam viņš pārcēlās uz darbu Google, un šobrīd viņu nodarbina Apple.

Briesmas

Nepareizās rokās dziļu viltus radīšanu var izmantot daudz vairāk nekā muļķīgu Nikolaja Keidža memelu viltošanai.

Edgars ČervantessLai arī manipulācijas ar saturu nav nekas jauns, agrāk tas prasīja nopietnas prasmes. Lai izveidotu viltotu saturu, jums bija nepieciešams jaudīgs dators un patiešām labs iemesls (vai vienkārši pārāk daudz brīvā laika). Deepfake izveides programmatūra, piemēram, FakeApp, ir bezmaksas, viegli atrodama un neprasa daudz datora enerģijas. Tā kā tas visu darbu veic pats par sevi, jums nav jābūt kvalificētam redaktoram, lai izveidotu ārprātīgi reālus multivides materiālus.

Tāpēc plaša sabiedrība, slavenības, politiskās vienības un valdības uztraucas par dziļu viltojumu kustību. Nepareizās rokās dziļu viltus radīšanu var izmantot daudz vairāk nekā muļķīgu Nikolaja Keidža memelu viltošanai. Iedomājieties, ka kāds rada viltus ziņas vai apsūdz video pierādījumus. Jūs varat pievienot problēmai viltus un atriebības porno. Lietas var ātri kļūt netīras.

Vēl viens iemesls uztraukties par dziļi viltus saturu ir tas, ka svarīgas personības varētu arī noliegt iepriekšējās darbības. Tā kā dziļi viltus video šķiet tik reāli, ikviens var apgalvot, ka īsts klips ir dziļa viltojums.

Lasīt arī: Ētikas un AI sarežģītība

Risinājuma meklēšana

Lai arī apmācītā acs ir ļoti tuvu reālai, tā tomēr var pamanīt viltus video, pievēršot tam īpašu uzmanību. Bažas rada tas, ka kādā nākotnē nākotnē mēs, iespējams, nespēsim pateikt atšķirību.

Twitter, Pornhub, Reddit un citi ir neveiksmīgi mēģinājuši atbrīvoties no šāda satura. Oficiālāk runājot, DARPA (Aizsardzības progresīvo pētījumu projektu aģentūra) sadarbojas ar pētniecības iestādēm un Kolorādo universitāti, lai radītu veidu, kā pamanīt dziļas parādības.

Labākais, ko mēs varam darīt, lai apkarotu dziļi viltus video, ir būt uzmanīgākam un mazāk uzkrītošam.

Edgars ČervantessKamēr mums nav programmatūras, kas šādos videoklipos varētu pamanīt pārkāpumus, labākais, ko mēs varam darīt, ir būt uzmanīgākam un mazāk ticamu. Pirms pieņemat, ka video, attēls vai audio ir reāls, veiciet pētījumu. Jebkurā gadījumā tas jau bija jādara.

Populārs dziļi fake saturs

Jordānija Pīle pievienojas Buzzfeed, lai saliktu šo video, kas ir paredzēts apziņas radīšanai.

Tiešsaistes manipulāciju eksperte Klēra Vardla parāda mums, cik reāli var izskatīties šie video, parādoties Adelei pirmajās 30 video sekundēs. Šis The New York Times videoklips sniedz mums lielisku ieskatu tēmā.

Watchmojo antaa ir izveidojis sarakstu ar dažiem populārākajiem videofilmu videoklipiem. Tas ir jautrs video ar daudz lielisku piemēru.

Vai jūs uztrauc dziļu viltus video sekas? Tā noteikti ir tēma, kas mums jāpatur prātā, vienlaikus strādājot pie risinājumu atrašanas.